目前胃癌已经成为全球发病率较高的五大恶性肿瘤之一,其致死率也位居前列。据统计,2015年我国约有67.9万人确诊为胃癌[1],其中约有49.8万人死亡。但有研究显示,早期胃癌的5年生存率超过90%[2],因此提高早期胃癌诊治能力是提升胃癌生存率的有效手段。

电子内镜检查技术已被广泛运用于胃肠道疾病的筛查和诊断中[3-4],尽管内镜成像技术,如NBI、放大内镜、激光共聚焦、细胞内镜的诞生,使得胃部早期病变的诊断率得到有效提高[5-6],但仍存在早期胃癌检出率低的现象。其主要原因在于:部分内镜医师缺乏早期胃癌的识别经验,对胃早癌病灶造成视而不见的现象[9]。除此之外,有些早期胃癌病灶在形态上与浅表性胃炎、胃溃疡、胃息肉等良性病变相似,难以作区分。因此内镜医师必须经过长期专业的培训和丰富的临床经验,才能具备识别早期胃癌的能力[2]。受限于内镜医师数量及相关早癌诊疗经验,加上我国人口众多,患者数量大,设备缺乏等原因,使得早期胃癌的检出率难以改善。

随着人工智能、大数据技术在医疗领域的飞速发展,凭借其强大的学习和计算能力,使得人工智能技术在消化系统肿瘤识别方面取得了巨大的进步。近年来,基于卷积神经网络的人工智能技术已经在胃肠道肿瘤识别上取得了显著的进步[7-19]。有文献证实,人工智能技术对识别早期胃癌的准确度、灵敏度上明显优于内镜医师[8-9]。

因此,我们将人工智能深度学习技术与消化道肿瘤数据相结合,构建了一套用于胃部早期癌症智能识别的辅诊模型,旨在解决早期胃癌难检出的临床诊断难题。

1 资料与方法 1.1 研究资料回顾性收集陆军军医大学第一附属医院内镜中心2016年1月至2020年8月的电子胃镜图片和胃镜检查完整视频。图片资料包括早期胃癌、慢性浅表性胃炎,胃溃疡、胃息肉和正常等五种类别。将图片数据随机分为训练集和验证集。训练集662例患者,共4 167张图片。验证集包含259例患者数据,共1 329张图片。验证集与训练集患者资料相互独立,无重合,构成比的标准化差异(Cohen’ d)较小。数据组成结构见表 1。

| 项目 | 胃早癌a | 慢性浅表性胃炎b | 胃息肉c | 胃溃疡d | 正常e |

| 训练集 | 1 217/29.21 | 235/5.64 | 522/12.53 | 340/8.16 | 1 853/44.47 |

| 验证集 | 507/38.15 | 112/8.43 | 97/7.30 | 122/9.18 | 491/36.95 |

| a:Cohen’d=0.19,b:Cohen’d=0.11,c:Cohen’d=0.18,d:Cohen’d=0.04,e:Cohen’d=0.15 | |||||

随机选取包含34例诊断为早期胃癌和非癌患者的视频。选取的视频记录了上消化道全部检查过程,不经任何剪辑,每个视频帧速率为60帧每秒。

本研究中的早期胃癌定义为术后病理诊断为高级别上皮内瘤变及黏膜内癌[3]。所有早期胃癌图片都经术后病理确诊,且利用光学电子染色成像和化学染色等方式确定出病灶范围。所有图像均在白光、非放大模式下拍摄,采集于奥林巴斯公司的260与290系列主机。本研究经过陆军军医大学附属西南医院伦理委员会批准[(B)KY2021076]。

1.2 图像预处理与模型构建 1.2.1 数据集构建训练CNN卷积神经网络模型所用的数据集共4 167张图片,均来源于陆军军医大学附属西南医院内镜中心2016年1月至2020年8月的电子胃镜检查中的图片,包括早期胃癌、慢性浅表性胃炎、胃溃疡、胃息肉和正常五种类别;其中早癌图片1 217张、良性病变图片1 097张、正常无病灶图片1 853张。

消化内镜资深专家参考每个病例的光学电子染色、碘染色图片和病理诊断结论,采用专门的标注工具对胃镜图片做分类及打框处理,形成真实标签。标注完成的图片再进行一系列预处理过程,包括图像的旋转、镜像、缩放、对比度调整、归一化等,以此来提高模型鲁棒性,增加泛化能力,同时增加模型输入样本的多样性。

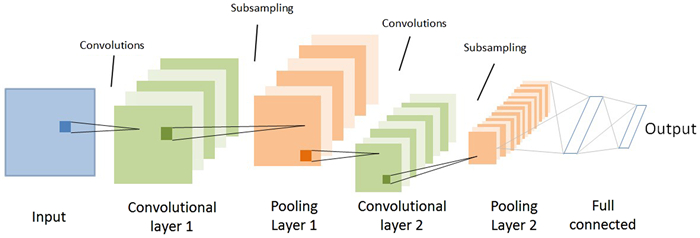

1.2.2 模型构建自主研发的神经网络模型由重庆金山科技(集团)有限公司人工智能实验室建立。模型采用的卷积神经网络(convolutional neural networks,CNN)包含卷积层、激活层、池化层和全连接层。其基本原理如下:首先,卷积层通过卷积核在输入图像上以一定步长平移,计算卷积核与输入图像对应位置元素的卷积,以此来对图像进行特征提取。激活层采用ReLU为激活函数把卷积层输出结果做非线性映射。接着,池化层对前一层的输出进行采样,将图像数据和参数进行压缩,减少过拟合,提高模型的容错性。而池化层通常采用最大池化的方法来达到特征降维和图像压缩的目的。经过多轮卷积、激励、池化处理后,图像中的信息已被转换成信息含量更高的特征,通过全连接层来完成分类和回归任务。该卷积神经网络的结构图如图 1所示。该模型首先在Imagenet大规模图像数据集上进行了预训练,得到了预训练模型。由于通过预训练后对网络的各个层进行了初始化,有助于用自己的小规模数据集训练时加快收敛速度。将预训练过的模型用自行构建的胃镜图片数据集进行二次训练,设置的主要训练参数包括:输入图像尺寸(416×416)像素、训练初始学习率(0.001)。经过多轮的迭代训练后从得到的模型文件中选择训练损失值最小的一个模型作为实验用的最终CNN模型。

|

| 图 1 卷积神经网络结构图 |

1.3 研究方法 1.3.1 人机分类竞赛

选择2位内镜工作年限超过5年且经验丰富的高年资医师,和2位内镜工作年限不足3年的低年资医师。4位内镜医师分别独立对验证集259例患者数据,共1 329张图片进行分类识别和判断,并同时记录下判断每张图片所花的时间。模型验证相同数据集,并记录结果。

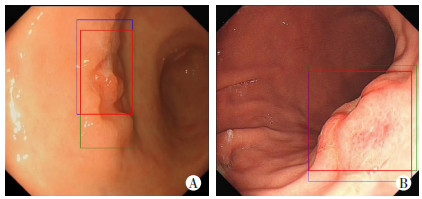

1.3.2 定位准确度分析选择内镜工作年限超过15年的正高级职称专家将胃早癌图片中的早癌病灶进行打框标注,结合每例早癌病灶的电子染色及碘染色图片确定出病灶边界和范围。将内镜专家标记方框与模型识别方框进行对比分析,确定出模型在不同规格的重合度。(图 2)

|

| A: 重合区域为0.683的内镜图片。B: 重合区域为0.902的内镜图片,绿色矩形框为内镜专家手动标记,蓝色矩形框为模型识别后标记,红色矩形框为两者重合区域 图 2 经标记的胃早癌内镜图像 |

1.3.3 视频验证

将模型集成在一专门用于内镜辅助诊断的系统中,该系统可实时显示模型识别内镜图像的结果,运用该系统依次播放上述34例视频。播放过程中,系统每秒对25帧图像进行分析识别,若这25帧图像中系统识别出病灶,则会以方框的形式标记出病灶位置和边界,同时将带有方框的图片截取在系统界面右侧,见图 3。系统识别出胃早癌则显示红框,识别非早癌病灶则用绿框表示。

|

| 图 3 内镜辅助诊断系统界面图片 |

内镜专家同时观看视频,记录下每例视频的病灶数量、位置和类别。通过查看系统保存的每例视频病灶图片,来判断系统识别每处病灶的准确性。

1.4 诊断效果评价指标的计算方法 1.4.1 人机分类竞赛统计内镜医师组与模型对胃早癌、胃息肉、胃溃疡、慢性浅表性胃炎和正常五个类别的灵敏度和阳性预测值(PPV),计算公式如下:

灵敏度=识别正确某一类别的图片数/该类别实际图片数

PPV=识别正确某一类别的图片数/被模型或内镜医师识别成该类别的图片数

1.4.2 定位准确度分析计算每张图片中模型与内镜专家标记方框的重合比率来衡量模型定位病灶的准确度。

重合比率=模型与专家标记方框的重合面积/专家标记方框的面积

1.4.3 视频验证统计34例内镜检查视频中的胃部早癌和非早癌病灶数量,计算模型识别病灶的灵敏度,统计步骤如下:

1) 由于每个视频的每处病灶在检查过程中会被多次拍摄,故内镜专家先将系统保存的该视频病灶图片按照不同病灶进行分类。因系统识别准确度、精度等原因,每处病灶的不同拍摄角度图片被系统同时识别为早癌和非早癌的情况。故判断该病灶是否被系统分类正确的标准为:当该处病灶识别正确的图片数大于识别错误的图片数,则系统分类正确,反之则分类错误。2)计算这34例视频系统识别早癌和非早癌的灵敏度。

1.5 统计学分析方法以上数据均采用SPSS20.0统计软件进行分析,计量资料采用x±s表示,计数资料用例数和率表示。不同组之间计量资料的比较,符合正态分布(或经转化后符合正态分布)且方差齐采用独立样本的t检验,方差不齐采用校正t检验,不符合正态分布采用非参数检验。不同组间的计数资料(率)的比较采用卡方检验,当理论频数不符合卡方检验条件时采用fisher精确概率检验。P<0.05认为差异有统计学意义。模型和医师识别各种胃部病变的灵敏度、PPV的比较采用配对卡方检验(McNemar检验)。检验模型识别早癌准确性使用模型识别结果与实际结果之间的配对卡方检验(McNemar检验)和kappa一致性检验,使用双侧检验,McNemar检验P<0.05认为识别结果有统计学差异;kappa检验的kappa值<0.4认为模型识别结果与实际结果一致性较差,0.4≤Kappa<0.75,说明模型识别结果与实际结果一致性一般,Kappa≥0.75,说明模型识别结果与实际结果一致性较好。

2 结果 2.1 人机分类竞赛验证集包含259例患者数据,共1 329张图片,平均每个病例约5张图片。其中包含507张胃早癌图片,胃息肉、胃溃疡、慢性浅表性胃炎和正常共822张。验证集与训练集患者资料相互独立,无重合。经内镜专家确认的验证集真实标签与模型、4位内镜医师识别的结果见表 3和表 4。在507张胃早癌数据集中,模型正确识别出458张(表 2),其灵敏度、PPV分别为90.33%、95.41%(表 3),模型诊断单张图片时间为(0.04±0.005)s。对比四名高低年资医师对胃早癌病灶识别的灵敏度及PPV,经用统计分析显示,模型普遍较内镜医师对于早癌病灶的检出率、诊断时间上均有差异,提示模型对早癌病灶的识别在检出率和诊断时间上均优于内镜医师组。

| 项目 | 胃早癌[张/(%)] | 慢性浅表胃炎[张/(%)] | 胃息肉[张/(%)] | 胃溃疡[张/(%)] | 正常[张/(%)] | 诊断时间/s |

| 验证集 | 507/38.15 | 112/8.43 | 97/7.30 | 122/9.18 | 491/36.95 | - |

| 模型 | 458/34.46 | 93/7.00 | 85/6.40 | 99/7.45 | 594/44.70 | 0.04±0.005 |

| 高年资医师1 | 409/30.78a | 86/6.47 | 90/6.77 | 97/7.30 | 647/48.68 | 6.5±1.72a |

| 高年资医师2 | 420/31.60 | 103/7.75 | 91/6.85 | 95/7.15 | 620/46.65 | 6.1±2.6a |

| 低年资医师1 | 390/29.35a | 80/6.02 | 80/6.02 | 93/7.00 | 686/51.62 | 8.1±1.95a |

| 低年资医师2 | 377/28.37a | 84/6.32 | 70/5.27 | 87/6.55 | 711/53.50 | 10.5±1.23a |

| a:P < 0.05,与模型组相比 | ||||||

| 项目 | 胃早癌 | 慢性浅表性胃炎 | 胃息肉 | 胃溃疡 | |

| 模型 | 灵敏度 | 90.34% | 83.03% | 87.62% | 81.14% |

| 阳性预测值 | 95.42% | 92.08% | 87.63% | 94.28% | |

| 高年资医师1 | 灵敏度a | 80.67% | 76.79% | 92.78% | 79.51% |

| 阳性预测值a | 93.59% | 83.50% | 90.00% | 71.85% | |

| 高年资医师2 | 灵敏度a | 82.84% | 91.96% | 93.81% | 77.87% |

| 阳性预测值a | 91.30% | 71.53% | 86.67% | 78.51% | |

| 低年资医师1 | 灵敏度a | 76.92% | 71.43% | 82.47% | 76.23% |

| 阳性预测值a | 85.90% | 58.82% | 84.21% | 74.40% | |

| 低年资医师2 | 灵敏度a | 74.36% | 75.00% | 72.16% | 71.31% |

| 阳性预测值a | 87.88% | 57.93% | 75.27% | 62.14% | |

| a:P < 0.05,与模型组相比(McNemar检验) | |||||

2.2 定位准确度分析

此数据集包含458张模型在分类实验中识别为胃早癌的图片,将胃早癌病灶按照形态特征分为隆起、平坦和凹陷三个类别。统计不同重合度在三种形态下的图片数量和每种形态的重合度占该形态总数的比率,详细结果见表 5,6。从表中可看出,重合度在60%以上的图片有380张,占总数的82.97%,随着重合度增加,图片数逐渐减少,重合度在90%以上的图片仅164张。经统计分析,在早期胃癌的三种不同形态方面,隆起形态的多种重合度(重合度≥60%、重合度≥70%)都比相应重合度的平坦和凹陷形态高(P=0.013、P=0.008),平坦形态的重合效果最差。

| 形态 | 数据集 | 重合度≥60%a | 重合度≥70%b | 重合度≥80%c | 重合度≥90%d |

| 隆起(张) | 218 | 191(87.61%) | 174(79.82%) | 135(61.93%) | 85(38.99%) |

| 平坦(张) | 79 | 58(73.42%) | 50(63.29%) | 37(46.84%) | 19(24.05%) |

| 凹陷(张) | 161 | 131(81.37%) | 113(70.19%) | 90(55.90%) | 60(37.27%) |

| 总计(张) | 458 | 380(82.97%) | 337(73.58%) | 262(57.21%) | 164(35.81%) |

| a:χ2=8.723,P=0.013;b:χ2=9.618,P=0.008;c:χ2=5.567,P=0.062;d:χ2=5.861,P=0.053 | |||||

| 模型 | 实际情况a | 合计 | |

| 胃早癌 | 非早癌 | ||

| 胃早癌 | 17 (5) | 5 (17) | 22 |

| 非早癌 | 2 (14) | 60 (48) | 62 |

| 合计 | 19 | 65 | 84 |

| McNemar检验结果提示,P=0.453; Kappa系数检验结果提示,Kappa值为0.775(P < 0.05);a括号中是根据χ2检验计算中的理论频数 | |||

2.3 视频验证

34例完整内镜检查视频共包含84处明显病灶,其中有19处胃早癌病灶,65处非早癌病灶。通过模型识别病灶的结果见表 5。表中可见,模型识别出的早癌病灶有17处,其灵敏度89.5%,识别出的非早癌病灶为60处,灵敏度92.3%。经统计结果分析,得出模型对早癌病灶的检出率与活检病理证实的早癌检出率吻合度较强,具有良好的一致性。

3 讨论在本研究中,我们搭建了一套基于卷积神经网络的深度学习模型,研究对胃早癌在识别准确性、定位精准性和实时运用上的表现。在我们的研究中,设计了三个实验,分别验证模型对静态的胃早癌、良性病变图片识别能力,对胃早癌病灶精准定位能力和动态实时识别胃早癌能力。

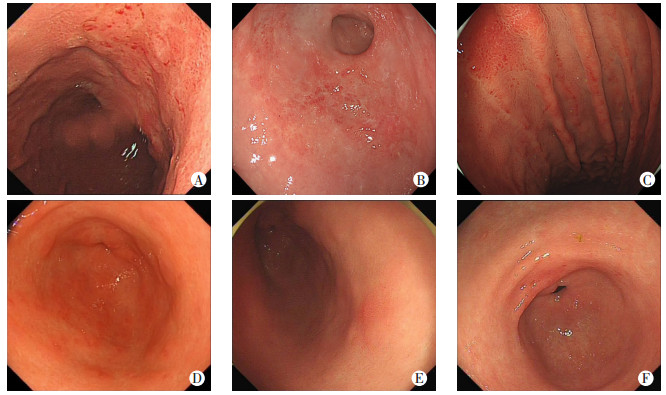

在人机分类竞赛实验中,我们采用了独立于训练集不同的病例数据组成验证集,更好地模拟真实使用情形。模型识别出90.33%的胃早癌图片,对浅表性胃炎、胃息肉和胃溃疡的识别率也均在80%以上。模型识在早癌病灶的识别上优于内镜医师组,且单张图片诊断速度最快。但胃早癌病灶图片仍有被模型漏诊的情况,模型将49张胃早癌图片分别诊断为浅表性胃炎和正常,是因这些图片中部分病灶在形态上都表现为平坦型,与浅表性胃炎的形态相似,与周围黏膜区分度不高。另一部分病灶尽管形态突出,但为远景拍摄,病灶颜色、纹理等特征不明显,易被模型忽视,出现漏诊情况。同样,模型也将部分良性病灶误诊为胃早癌,也许是因为这些良性病灶与胃早癌在形态上高度相似,区分较困难(图 4)。甚至对于经验丰富的内镜医师,仅仅观察正常放大倍率的白光图片也很难正确区分胃早癌与慢性浅表性胃炎[7]。

|

| A、B.模型将胃早癌误识别为胃炎。C、D:模型将胃炎误识别为胃早癌。E、F:被模型遗漏的胃早癌病灶 图 4 被模型识别错误的图片 |

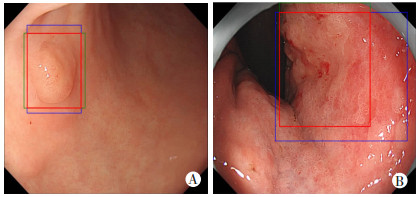

在识别定位分析中,将模型识别病灶的方框与资深内镜专家依据病理组织、化学或光学染色确定出病灶方框的重合比率作为衡量模型精准定位的标准。重合比率越高,模型定位病灶越准确。在我们实验中,重合比率在60%以上的图片占总图片数的82.97%,随着重合度增加,重合度在90%以上的图片仅为35.81%。在三种形态的胃早癌中,模型对隆起型早癌病灶定位最准确,不同规格(重合度≧60%、重合度≧70%)的重合度也最高,而平坦型病灶最差。这可能是因为从形态上看,隆起型病灶与周围正常黏膜边界清晰、明显;从特征上看,隆起型病变的颜色、纹理、轮廓等信息较正常黏膜更突出,模型更易识别到病灶边界,确定出病灶范围(图 5A)。对于平坦型病变,病灶与正常黏膜界限不清,模型难以正确区分出两者的分界点,导致模型框出更多正常黏膜或并未将病灶框完全,使得模型识别方框与专家标注方框的重合比率低(图 5B)。

|

| A:隆起型病灶,B: 平坦型病灶。绿色矩形框为专家标记,蓝色矩形框为模型识别,红色矩形框为两者重合区域 图 5 不同形态胃早癌病灶专家标注和CNN模型智能标注对照图 |

视频验证中,将模型集成在辅诊系统中,可对视频数据集进行实时识别并显示结果。该系统在视频播放过程中,能将识别到的病灶用方框框出病灶边界及范围,并将此图像截取显示在系统右侧,每识别到病灶,带有方框的病灶图像就会实时更新在界面右侧,最后系统将截取的全部病灶图像保存在特定目录下,便于查看。将系统截取的病灶图像去除食管、十二指肠、NBI和活检治疗部分,仅对胃部病灶图像进行分析判断,发现系统识别胃早癌病灶的灵敏度较高,准确识别17处胃早癌病灶,仅有两处误识别成非早癌病灶,是因为这两处病灶在形态上表现较为平坦,黏膜发红,病灶尺寸较小,与糜烂病灶形态上相似。在识别非早癌方面,识别灵敏度高达92.3%,系统将极少部分非早癌病灶误识别为早癌病灶,但同时也存在两处病灶遗漏的情况。误识别的非早癌病灶大多数出现在胃窦部,由于内镜检查时胃窦部充盈程度不够,使病灶在形态上均呈现出明显隆起状态,同时伴有黏膜充血、发红、肿胀,与胃早癌隆起型病变相类似。而漏诊的情况是因视频对遗漏的病灶拍摄时间短,距离远,加上病灶不明显,造成模型的忽视。

在我们的研究中发现,基于卷积神经网络的模型对识别早期胃癌具有较高的灵敏性和阳性预测值,以及在病灶识别速度上,优于内镜医师组。同时,在此研究中,我们纳入了多种易与胃早癌在形态、高度上相似的良性病变,作为胃早癌识别的干扰项,增加了模型识别的难度。而选取的胃息肉、胃溃疡和浅表性胃炎等良性病变也是实际临床内镜检查中常见的胃部疾病,容易与胃早癌混淆。我们设计的模型不仅能提示出胃早癌病灶在图像中的具体区域,也能精确地识别出早癌病灶的范围和边界,进一步辅助内镜医师对诊断该病灶提供参考建议。由于模型单张识别速度快,也可将模型运用在视频数据上进行实时识别,用于本文中验证实验的视频数据为完整的内镜胃部检查视频,并未对视频进行剪辑,这样更能模拟临床真实使用场景。虽视频中出现的运动模糊、反光、黏膜不干净等低质量画面都对模型识别造成一定干扰,但模型整体识别效果表现良好。

然而,我们研究中也存在一些不足之处。首先,用于模型训练及验证的数据仅来自单中心,采用回顾性的方法进行收集,数据的样本量也相对较少,并未完全覆盖实际临床运用中可能遇到的各种形态病灶,且入选的图片拍摄角度单一、画面清晰,同时剔除了部分不明显病灶图片,这将使模型在真实使用时稳定性降低。其次,本文仅研究了三种常见胃部良性疾病与胃早癌进行鉴别,种类较少,其余良性疾病,如:疣状胃炎、脂肪瘤等并未纳入对照组中。最后,本文实验采用的数据仅为白光非放大内镜图片,缺乏内镜检查过程中常见的NBI,BLI,化学染色等图像。

本文设计的基于卷积神经网络的人工智能模型在识别早期胃癌方面具有较高的灵敏性和阳性预测值,并且具有实时检测的能力。我们相信在未来的研究中,加大训练及验证样本量,增加数据多样性,同时优化模型算法,会更好的适用于临床真实场景,具有更高的准确性、灵敏性,辅助内镜医师针对早癌胃癌做出更准确的诊断,减轻工作负担。

| [1] |

CHEN W J, ZHENG R S, Baade P D, et al. Cancer statistics in China, 2015[J]. CA Cancer J Clin, 2016, 66(2): 115-132. |

| [2] |

HIRASAWA T, AOYAMA K, TANIMOTO T, et al. Application of artificial intelligence using a convolutional neural network for detecting gastric cancer in endoscopic images[J]. Gastric Cancer, 2018, 21(4): 653-660. |

| [3] |

蔡世伦, 阿依木克地斯·亚力孔, 李染, 等. 基于深度学习的人工智能辅助诊断在食管早癌中的应用[J]. 中华消化内镜杂志, 2019, 36(4): 246-250. CAI S L, AYIMUKEDISI Y, LI R, et al. Application of artificial intelligence assisted diagnosis based on deep learning for early esophageal cancer[J]. Chin J Digestive Endosc, 2019, 36(4): 246-250. |

| [4] |

BANG C S, BAIK G H, KIM J H, et al. Effect of training in upper endoscopic biopsy[J]. Korean J Helicobacter Up Gastrointest Res, 2015, 15(1): 33. |

| [5] |

MUGURUMA N, MIYAMOTO H, OKAHISA T, et al. Endoscopic molecular imaging: status and future perspective[J]. Clin Endosc, 2013, 46(6): 603-610. |

| [6] |

COHEN J, SAFDI M A, DEAL S E, et al. Quality indicators for esophagogastroduodenoscopy[J]. Am J Gastroenterol, 2006, 101(4): 886-891. |

| [7] |

IKENOYAMA Y, HIRASAWA T, ISHIOKA M, et al. Detecting early gastric cancer: Comparison between the diagnostic ability of convolutional neural networks andendoscopists[J]. Dig Endosc, 2021, 33(1): 141-150. |

| [8] |

WU L, ZHOU W, WAN X, et al. A deep neural network improves endoscopic detection of early gastric cancer without blind spots[J]. Endoscopy, 2019, 51(6): 522-531. |

| [9] |

王智杰, 高杰, 孟茜茜, 等. 基于深度学习的人工智能技术在早期胃癌诊断中的应用[J]. 中华消化内镜杂志, 2018, 35(8): 551-556. WANG Z J, GAO J, MENG Q Q, et al. Artificial intelligence based on deep learning for automatic detection of early gastric cancer[J]. Chin J Digestive Endosc, 2018, 35(8): 551-556. |

| [10] |

LI Y P, DENG L Y, YANG X H, et al. Early diagnosis of gastric cancer based on deep learning combined with the spectral-spatial classification method[J]. Biomed Opt Express, 2019, 10(10): 4999-5014. |

| [11] |

GUIMARÃES P, KELLER A, FEHLMANN T, et al. Deep-learning based detection of gastric precancerous conditions[J]. Gut, 2020, 69(1): 4-6. |

| [12] |

ZHU Y, WANG Q C, XU M D, et al. Application of convolutional neural network in the diagnosis of the invasion depth of gastric cancer based on conventional endoscopy[J]. Gastrointest Endosc, 2019, 89(4): 806-815.e1. |

| [13] |

ZHANG X, HU W L, CHEN F, et al. Gastric precancerous diseases classification using CNN with a concise model[J]. PLoS ONE, 2017, 12(9): e0185508. |

| [14] |

LI L, CHEN Y S, SHEN Z, et al. Convolutional neural network for the diagnosis of early gastric cancer based on magnifying narrow band imaging[J]. Gastric Cancer, 2020, 23(1): 126-132. |

| [15] |

HORIUCHI Y, AOYAMA K, TOKAI Y, et al. Convolutional neural network for differentiating gastric cancer from gastritis using magnified endoscopy with narrow band imaging[J]. Dig Dis Sci, 2020, 65(5): 1355-1363. |

| [16] |

KANESAKA T, LEE T C, UEDO N, et al. Computer-aided diagnosis for identifying and delineating early gastric cancers in magnifying narrow-band imaging[J]. Gastrointest Endosc, 2018, 87(5): 1339-1344. |

| [17] |

MIYAKI R, YOSHIDA S, TANAKA S, et al. A computer system to be used with laser-based endoscopy for quantitative diagnosis of early gastric cancer[J]. J Clin Gastroenterol, 2015, 49(2): 108-115. |

| [18] |

CHO B J, BANG C S, PARK S W, et al. Automated classification of gastric neoplasms in endoscopic images using a convolutional neural network[J]. Endoscopy, 2019, 51(12): 1121-1129. |

| [19] |

LEE J H, KIM Y J, KIM Y W, et al. Spotting malignancies from gastric endoscopic images using deep learning[J]. Surg Endosc, 2019, 33(11): 3790-3797. |